本文为您介绍如何使用数据传输迁移 RDS PostgreSQL 实例的数据至 OceanBase 数据库 Oracle 租户。

如果数据迁移任务长期处于非活跃状态(任务状态为 失败、已暂停 或 已完成),受增量日志保留时长等影响,任务可能无法恢复。数据传输将主动释放处于非活跃状态超过 3 天的数据迁移任务,以回收相关资源,建议您为任务配置告警并及时处理任务相关异常。

前提条件

数据传输已具备云资源访问权限。详情请参见 数据传输迁移角色授权。

已为源端 RDS PostgreSQL 实例创建专用于数据迁移任务的高权限账号。详情请参见 PostgreSQL 数据源。

已为目标端 OceanBase 数据库 Oracle 租户创建专用于数据迁移任务的数据库用户,并为其赋予了相关权限。详情请参见 创建数据库用户。

如果您需要进行增量同步,请完成以下前置操作:

增量同步时,数据传输不支持 DDL 的自动同步。如果待迁移的表需要进行 DDL,请先手动在目标端执行该 DDL 语句,再在源端 RDS PostgreSQL 实例中执行。

为确保执行 DDL 语句后的增量 DML 能够正确解析,您需要创建对应的触发器和记录 DDL 语句的表。详情请参见 创建触发器。

勾选增量同步后,

wal_level参数必须设置为 logical。详情请参见 修改 RDS PostgreSQL 实例的日志级别。

使用限制

源端数据库的操作限制

请勿在结构迁移和全量迁移阶段执行库或表结构变更的 DDL 操作,否则可能造成数据迁移任务中断。

目前支持的 RDS PostgreSQL 实例版本为 V11.x 和 V12.x。

数据传输不支持迁移 RDS PostgreSQL 实例的分区表、unlogged 表和临时表。

目标端是数据库的情况下,数据传输不支持目标端存在触发器(Trigger)。如果存在触发器,可能导致数据迁移失败。

数据传输仅支持迁移库名、表名和列名为 ASCII 码且不包含特殊字符(包括换行、空格,以及 .|"'`()=;/&\)的对象。

增量同步仅支持从主库进行同步。

注意事项

勾选增量同步后,表级复制标识

REPLICA IDENTITY的要求如下:如果您通过 指定对象 入口选择迁移对象,则指定的表需要具备主键,或者表级复制标识

REPLICA IDENTITY为 FULL,否则将导致业务数据的更新、删除操作失败。如果您通过 匹配规则 入口选择迁移对象,RDS PostgreSQL 实例需要订阅已选数据库的所有表 (包括已选表、未选表和新增表),且所有表均需要包含主键,或者表级复制标识

REPLICA IDENTITY为 FULL,否则将导致业务数据的更新、删除操作失败。

修改表级复制标识

REPLICA IDENTITY为 FULL 的命令如下。ALTER TABLE table_name REPLICA IDENTITY FULL;RDS PostgreSQL 实例的数据迁移(结构迁移或增量 DDL)至 OceanBase 数据库 Oracle 租户时,表名、字段名将根据数据传输的默认策略转为大写。例如,源端的表名为 a,则目标端默认转为 A。您可以通过 a、A 或 “A” 的方式使用表名、字段名,但不支持以 “a” 的方式使用表名、字段名。

RDS PostgreSQL 实例的增量组件会自动创建 publication 和 slot,但需要您对 RDS PostgreSQL 实例日志文件的磁盘使用情况进行监控。数据传输默认每 10 分钟通知更新一次 slot 的

confirmed_flush_lsn为 10 分钟以前的 lsn,因此每个增量组件至少会保存 10 分钟以上的 RDS PostgreSQL 实例日志文件。说明如果您需要修改通知的间隔周期,或修改通知 RDS PostgreSQL 实例可以清理多久之前的日志文件,请联系技术支持人员。

数据迁移过程中,如果因为存在 slot 而无法清理 RDS PostgreSQL 实例的日志文件,则需要彻底删除数据迁移任务后,再清理 RDS PostgreSQL 实例的日志。RDS PostgreSQL 实例的日志文件是否能被回收,取决于所有 slot 中最早的

slot restart_lsn是否在日志文件范围内。如果表没有主键或所有列具备 Not Null 的唯一键,则迁移数据至目标端时,可能出现重复数据。

在反向增量场景中,对于 UPDATE、DELETE 采用全列匹配的方式迁移数据,可能出现以下问题。

可能会出现性能问题。

由于缺少主键索引,每次的 UPDATE 和 DELETE 操作都会在全表扫描之后进行。

可能会出现数据一致性问题。

由于 UPDATE 和 DELETE 操作在 RDS PostgreSQL 中不支持 LIMIT 语法,当全列匹配时匹配到多条数据,可能会出现 UPDATE 或 DELETE 数据比目标端多的情况。例如,无主键表 t1 中存在 c1 和 c2 两列,在源端有两条 c1=1 和 c2=2 的数据。当源端删除其中一条数据时,由于匹配条件是 where c1 = 1 and c2 = 2,会导致目标端的两条 c1=1 和 c2=2 的数据均被删除,导致源端和目标端的数据不一致。

对于 tsvector 类型字段的迁移,如果涉及反向增量至 RDS PostgreSQL 实例,在 OceanBase 数据库写入对应字段的数据,需要符合 tsvector 的格式。例如:

OceanBase 数据库写入 'a b c' 至 RDS PostgreSQL 实例会转换为 "'a' 'b' 'c'"。

OceanBase 数据库写入 'a:1 b:2 c:3' 至 RDS PostgreSQL 实例会转换为 "'a':1 'b':2 'c':3"。

如果 OceanBase 数据库写入非 tsvector 格式的数据 "'a':cccc",则 RDS PostgreSQL 实例将写入异常导致失败。更多 tsvector 格式说明请参见 PostgreSQL 官方文档。

如果源端字符集为 UTF-8,建议目标端使用兼容源端的字符集(例如,UTF-8、UTF-16 等),避免因字符集不兼容导致目标端出现乱码等问题。

请确认数据传输对 DECIMAL、FLOAT 或 DOUBLE 等列类型的迁移精度是否符合预期。如果目标端字段类型的精度小于源端字段类型的精度,则可能发生截断现象,导致源端和目标端的数据不一致。

如果您变更目标端的唯一索引,需要重启数据迁移任务,否则可能存在数据不一致的问题。

节点之间的时钟不同步,或者电脑终端和服务器之间的时钟不同步,均可能导致延迟时间(增量同步/反向增量)不准确。

例如,如果时钟早于标准时间,可能导致延迟时间为负数。如果时钟晚于标准时间,可能导致延迟。

库表汇聚场景下:

建议您使用匹配规则的方式映射源端和目标端的关系。

建议您在目标端自行创建表结构。如果使用数据传输创建,请在结构迁移步骤跳过部分失败对象。

如果在创建数据迁移任务时,您仅配置了 增量同步,数据传输将要求源端数据库的本地增量日志保存 48 小时以上。

如果在创建数据迁移任务时,您配置了 全量迁移+增量同步,数据传输要求源端数据库的本地增量日志至少保留 7 天以上。否则数据传输可能因无法获取增量日志而导致数据迁移任务失败,甚至导致源端和目标端数据不一致。

如果源端或目标端存在仅大小写不同的表对象,可能会因为源端或目标端大小写不敏感导致数据迁移的结果不符合预期。

如果唯一约束列允许 NULL 值,可能出现数据丢失的问题。在 PostgreSQL 数据库中多个 NULL 值同步至 OceanBase 数据库 Oracle 租户时,仅第一个 NULL 值被成功插入,后续 NULL 值会因唯一约束列冲突被丢弃。

支持的源端和目标端实例类型

下表中,OceanBase 数据库 Oracle 租户简称为 OB_Oracle。

源端 | 目标端 |

PostgreSQL(RDS 实例) | OB_Oracle(OceanBase 集群实例) |

PostgreSQL(RDS 实例) | OB_Oracle(VPC 内自建数据库) |

数据类型映射

RDS PostgreSQL 实例 | OceanBase 数据库 Oracle 租户 |

int | NUMBER(10) |

smallint | NUMBER(5) |

bigint | NUMBER(20) |

decimal | NUMBER(p,s) |

numeric | NUMBER(p,s) |

real | BINARY_FLOAT |

double precision | BINARY_DOUBLE |

smallserial | NUMBER(5) |

serial | NUMBER(10) |

bigserial | NUMBER(20) |

char | CHAR(n) 说明

|

varchar | VARCHAR2(n) |

text | CLOB |

timestamp | TIMESTAMP(p) |

timestamp with time zone | TIMESTAMP(p) WITH TIME ZONE |

time | DATE |

time with time zone | TIMESTAMP(p) WITH TIME ZONE |

boolean | NUMBER(1) |

bytea | BLOB |

citext | CLOB |

tsvector | CLOB |

操作步骤

登录 OceanBase 管理控制台,购买数据迁移项目。

详情请参见 购买数据迁移任务。

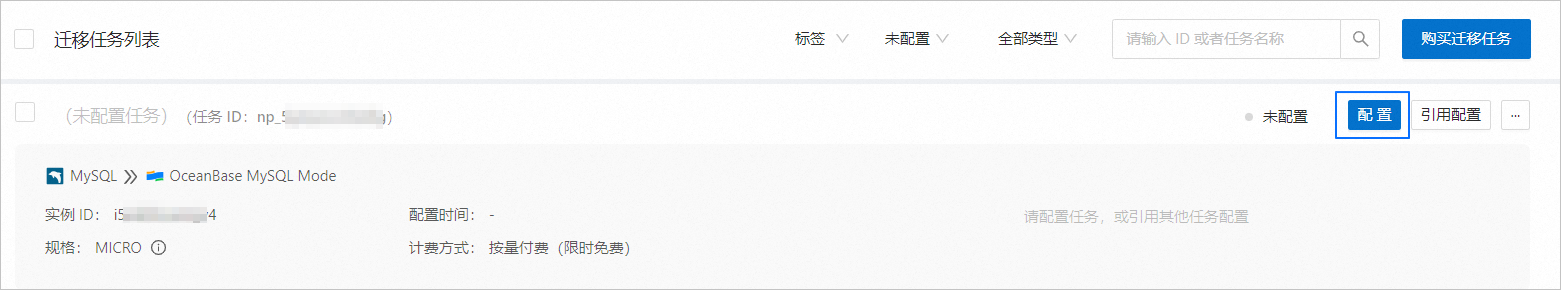

在 数据传输 > 数据迁移 页面,单击新购买的数据迁移项目后的 配置。

如果您需要引用已有的项目配置信息,可以单击 引用配置。详情请参见 引用数据迁移任务配置。

在 选择源和目标 页面,配置各项参数。

参数

描述

迁移任务名称

建议使用中文、数字和字母的组合。名称中不能包含空格,长度不能超过 64 个字符。

源端

如果您已新建 PostgreSQL 数据源,请从下拉列表中进行选择。如果未新建,请单击下拉列表中的 新建数据源,在右侧对话框进行新建。参数详情请参见 新建 PostgreSQL 数据源。

目标端

如果您已新建 OceanBase 数据库 Oracle 租户数据源,请从下拉列表中进行选择。如果未新建,请单击下拉列表中的 新建数据源,在右侧对话框进行新建。参数详情请参见 新建 OceanBase 数据源。

标签(可选)

单击文本框,在下拉列表中选择目标标签。您也可以单击 管理标签 进行新建、修改和删除。详情请参见 通过标签管理数据迁移任务。

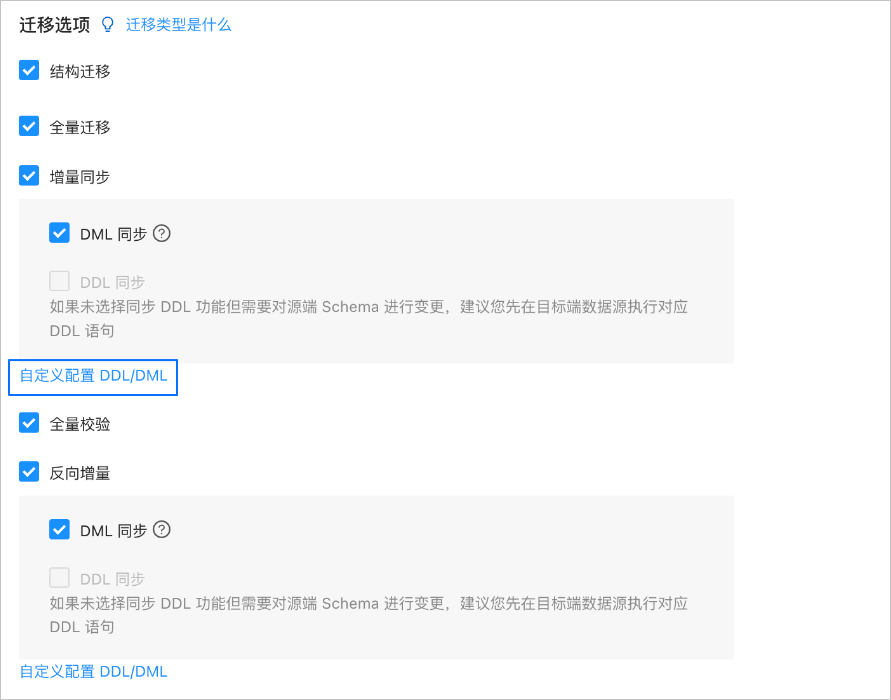

单击 下一步。在 选择迁移类型 页面,选择当前数据迁移任务的迁移类型。

迁移类型 包括 结构迁移、全量迁移、增量同步、全量校验 和 反向增量。

迁移类型

描述

结构迁移

结构迁移任务开始后,数据传输会迁移源库中的数据对象定义(表、索引、约束、注释和视图等)至目标端数据库中,并自动过滤临时表。

全量迁移

全量迁移任务开始后,数据传输会将源端库表的存量数据迁移至目标端数据库对应的表中。

增量同步

增量同步任务开始后,数据传输会同步源库发生变化的数据(新增、修改或删除)至目标端数据库对应的表中。

增量同步 支持 DML 同步,您可以根据需求进行自定义配置。详情请参见 自定义配置 DDL/DML。

全量校验

在全量迁移完成、增量数据同步至目标端并与源端基本追平后,数据传输会自动发起一轮针对源端数据库配置的数据表和目标表的全量数据校验任务。

说明如果您选择了 增量同步,且 DML 同步 选项中未选择所有的 DML,则数据传输不支持本场景下的全量数据校验。

数据传输仅支持对唯一键表(指具有主键或者非空唯一键的表)进行全量数据校验。

反向增量

反向增量任务开始后,可以实时将业务切换后在目标端数据库产生的变更数据回流至源端数据库。

通常反向增量会复用增量同步的配置,您也可以根据实际需求进行自定义配置。

单击 下一步。在 选择迁移对象 页面,选择当前数据迁移任务的迁移对象。

您可以通过 指定对象 和 匹配规则 两个入口选择迁移对象。本文为您介绍通过 指定对象 方式选择迁移对象的具体操作,配置匹配规则的详情请参见 配置和修改匹配规则。

重要待迁移的表名和其中的列名不能包含中文字符。

当数据库的库名或表名存在“$$”字符时,会影响数据迁移任务的创建。

在 选择迁移对象 区域,选中 指定对象。

在 选择迁移范围 区域的 源端对象 列表选中需要迁移的对象。您可以选择一个或多个库的表、视图作为迁移对象。

单击 >,将其添加至 目标端对象 列表中。

数据传输支持通过文本导入对象,并支持对目标端对象进行重命名、设置行过滤、查看列信息,以及移除单个或全部迁移对象等操作。

说明通过 匹配规则 方式选择迁移对象时,重命名能力由匹配规则语法覆盖,操作处仅支持设置过滤条件。详情请参见 配置和修改匹配规则。

操作

描述

导入对象

在选择区域的右侧列表中,单击右上角的 导入对象。

在对话框中,单击 确定。

重要导入会覆盖之前的操作选择,请谨慎操作。

在 导入迁移对象 对话框中,导入需要迁移的对象。

您可以通过导入 CSV 文件的方式进行库表重命名、设置行过滤条件等操作。详情请参见 下载和导入迁移对象配置。

单击 检验合法性。

完成迁移对象导入后,请先检验合法性。目前暂不支持列字段映射。

通过检验后,单击 确定。

重命名

数据传输支持重命名迁移对象的名称,详情请参见 数据库库表重命名。

设置

数据传输支持

WHERE条件实现行过滤,详情请参见 SQL 条件过滤数据。您还可以在 查看列 区域,查看迁移对象的列信息。

移除/全部移除

数据传输支持在数据映射时,对暂时选中到目标端的单个或多个对象进行移除操作。

移除单个迁移对象

在选择区域的右侧列表中,鼠标悬停至目标对象,单击显示的 移除,即可移除该迁移对象。

移除全部迁移对象

在选择区域的右侧列表中,单击右上角的 全部移除。在对话框中,单击 确定,即可移除全部迁移对象。

单击 下一步。在 迁移选项 页面,配置各项参数。

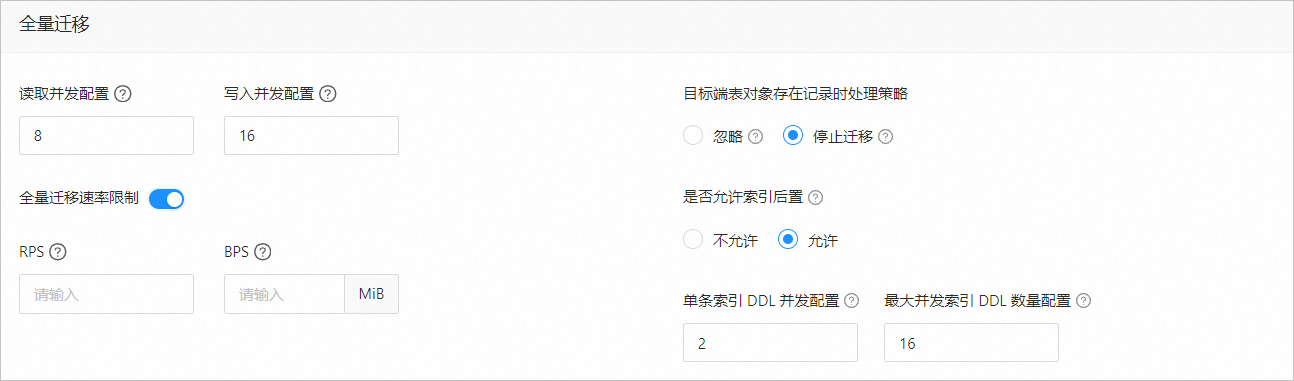

全量迁移

在 选择迁移类型 页面,选中 全量迁移,才会显示下述参数。

参数

描述

读取并发配置

该参数用于配置全量迁移阶段从源端读取数据的并发数,最大限制为 512 并发数过高可能会造成源端压力过大,影响业务。

写入并发配置

该参数用于配置全量迁移阶段往目标端写入数据的并发数,最大限制为 512。并发数过高可能会造成目标端压力过大,影响业务。

全量迁移速率限制

您可以根据实际需求决定是否开启全量迁移速率限制。如果开启,请设置 RPS(全量迁移阶段每秒最多可以迁移至目标端的数据行数的最大值限制)和 BPS(全量迁移阶段每秒最多可以迁移至目标端的数据量的最大值限制)。

说明此处设置的 RPS 和 BPS 仅作为限速限流能力,全量迁移实际可以达到的性能受限于源端、目标端、实例规格配置等因素的影响。

目标端表对象存在记录时处理策略

处理策略包括 忽略 和 停止迁移:

选择 忽略:当目标端表对象存在数据时,如果原数据与写入数据冲突,数据传输采用将冲突数据记录日志,保留原数据不变的策略进行数据写入。

重要选择 忽略,全量校验将使用 IN 模式拉取数据,无法校验目标端存在源端没有的数据的场景,并且校验性能会有一定程度降级。

选择默认值 停止迁移:当目标端表对象存在数据时,全量迁移会报错不允许迁移,请处理好目标端数据后再继续迁移。

重要如果出错后单击恢复,数据传输将忽略该配置选项,继续迁移表数据,请谨慎操作。

是否允许索引后置

您可以设置是否允许全量数据迁移完成后再创建索引,索引后置功能能够缩短全量迁移耗时。选择索引后置的注意事项,请参见表格下方的说明。

重要在 选择迁移类型 页面同时选中 结构迁移 和 全量迁移,才会显示该参数。

仅非唯一键索引支持后置创建。

执行索引时,如果目标端 OceanBase 数据库遇到下述报错,数据传输会进行忽略,默认索引创建成功,不会再重复创建。

OceanBase 数据库 MySQL 租户报错

Duplicate key name。OceanBase 数据库 Oracle 租户报错

name is already used by an existing object。

当目标端为 OceanBase 数据库,并且此处选择 允许 后,请进行下述配置:

单条索引 DDL 并发配置:并行度越高,资源消耗越大,迁移速度越快。

最大并发索引 DDL 数量配置:同一时刻,系统调用的后置索引 DDL 数量的最大值限制。

允许索引后置的情况下,建议您根据 OceanBase 数据库的硬件条件和当前业务流量情况,通过黑屏客户端工具调整以下业务租户参数。

// 文件内存缓冲区限制 alter system set _temporary_file_io_area_size = '10' tenant = 'xxx'; // V4.x 关闭限流 alter system set sys_bkgd_net_percentage = 100;增量同步

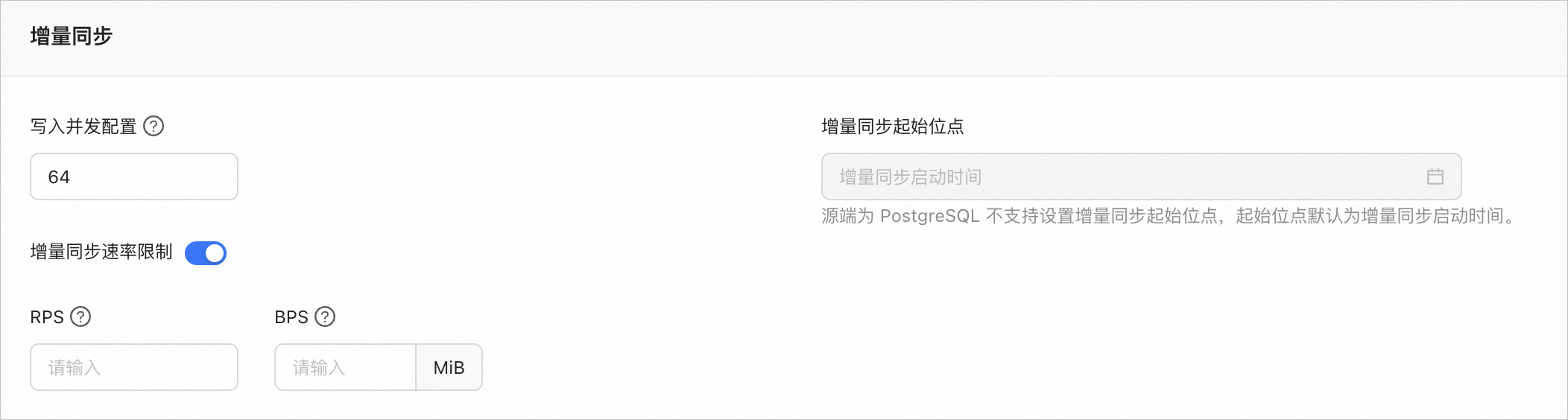

在 选择迁移类型 页面,选中 增量同步,才会显示下述参数。

参数

描述

写入并发配置

该参数用于配置增量同步阶段往目标端写入数据的并发数,最大限制为 512。并发数过高可能会造成目标端压力过大,影响业务。

增量同步速率限制

您可以根据实际需求决定是否开启增量同步速率限制。如果开启,请设置 RPS(增量同步阶段每秒最多可以同步至目标端的数据行数的最大值限制)和 BPS(增量同步阶段每秒最多可以同步至目标端的数据量的最大值限制)。

说明此处设置的 RPS 和 BPS 仅作为限速限流能力,增量同步实际可以达到的性能受限于源端、目标端、实例规格配置等因素的影响。

增量同步起始位点

选择迁移类型时未选择 全量迁移,才显示该参数。但源端为 PostgreSQL 时,不支持设置增量同步起始位点,起始位点默认为增量同步启动时间。

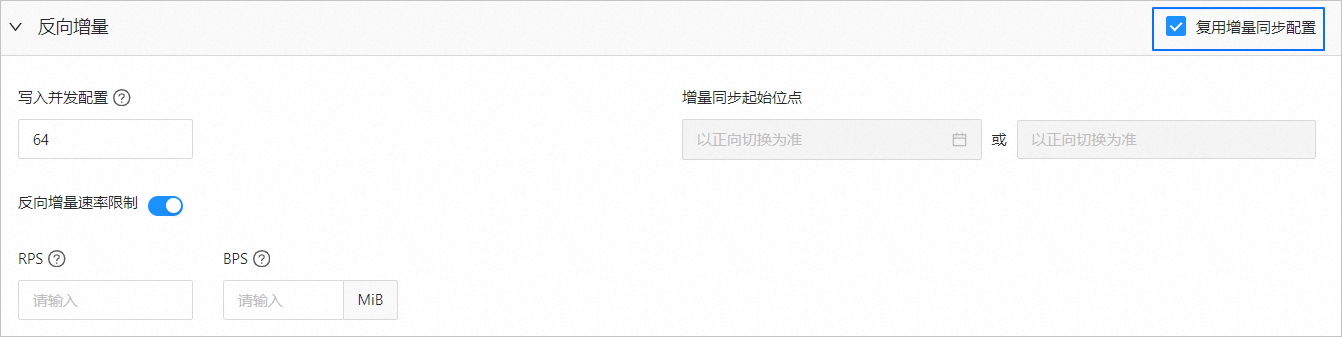

反向增量

在 选择迁移类型 页面,选中 反向增量,才会显示该区域的参数。反向增量的配置参数默认 复用增量同步配置。

您也可以取消复用增量同步配置,根据实际需求进行配置。

参数

描述

写入并发配置

该参数用于配置反向增量阶段往源端写入数据的并发数,最大限制为 512。并发数过高可能会造成源端压力过大,影响业务。

反向增量速率限制

您可以根据实际需求决定是否开启反向增量速率限制。如果开启,请设置 RPS(反向增量同步阶段每秒最多可以同步至源端的数据行数的最大值限制)和 BPS(反向增量同步阶段每秒最多可以同步至源端的数据量的最大值限制)。

说明此处设置的 RPS 和 BPS 仅作为限速限流能力,反向增量同步实际可以达到的性能受限于源端、目标端、实例规格配置等因素的影响。

增量同步起始位点

如果选择迁移类型时已选择 全量迁移,则不显示该参数。

如果选择迁移类型时未选择 全量迁移,但选择了 增量同步,则默认以正向切换(如有)为准,不支持修改。

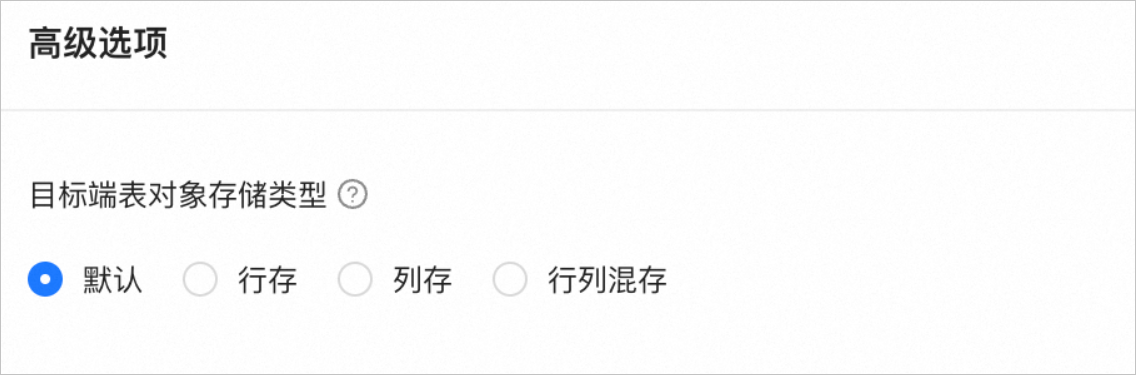

高级选项

当目标端 OceanBase 数据库 Oracle 租户为 V4.3.0 及之后版本,并且在 选择迁移类型 页面,选中 结构迁移,才会显示该区域的参数。

目标端表对象存储类型包括 默认、行存、列存 和 行列混存,该配置用于确定结构迁移或增量同步时目标端表对象的存储类型,详情请参见 default_table_store_format。

说明默认 选项是根据目标端参数配置自适应其他选项,是结构迁移的表对象根据设置的存储类型写入对应的结构。

单击 预检查,系统对数据迁移任务进行预检查。

在 预检查 环节,数据传输会检查数据库用户的读写权限、数据库的网络连接等是否符合要求。全部检查任务均通过后才能启动数据迁移任务。如果预检查报错:

您可以在排查并处理问题后,重新执行预检查,直至预检查成功。

您也可以单击错误预检查项操作列中的 跳过,会弹出对话框提示您跳过本操作的具体影响,确认可以跳过后,请单击对话框中的 确定。

预检查成功后,单击 启动任务。

如果您暂时无需启动任务,请单击 保存。后续您只能在 迁移任务列表 页面手动启动任务或通过批量操作启动任务。批量操作的详情请参见 批量操作数据迁移任务。

数据传输支持在数据迁移任务运行过程中修改迁移对象及其行过滤条件,详情请参见 查看和修改迁移对象及其过滤条件。数据迁移任务启动后,会根据所选择的迁移类型依次执行,详情请参见 查看迁移详情。